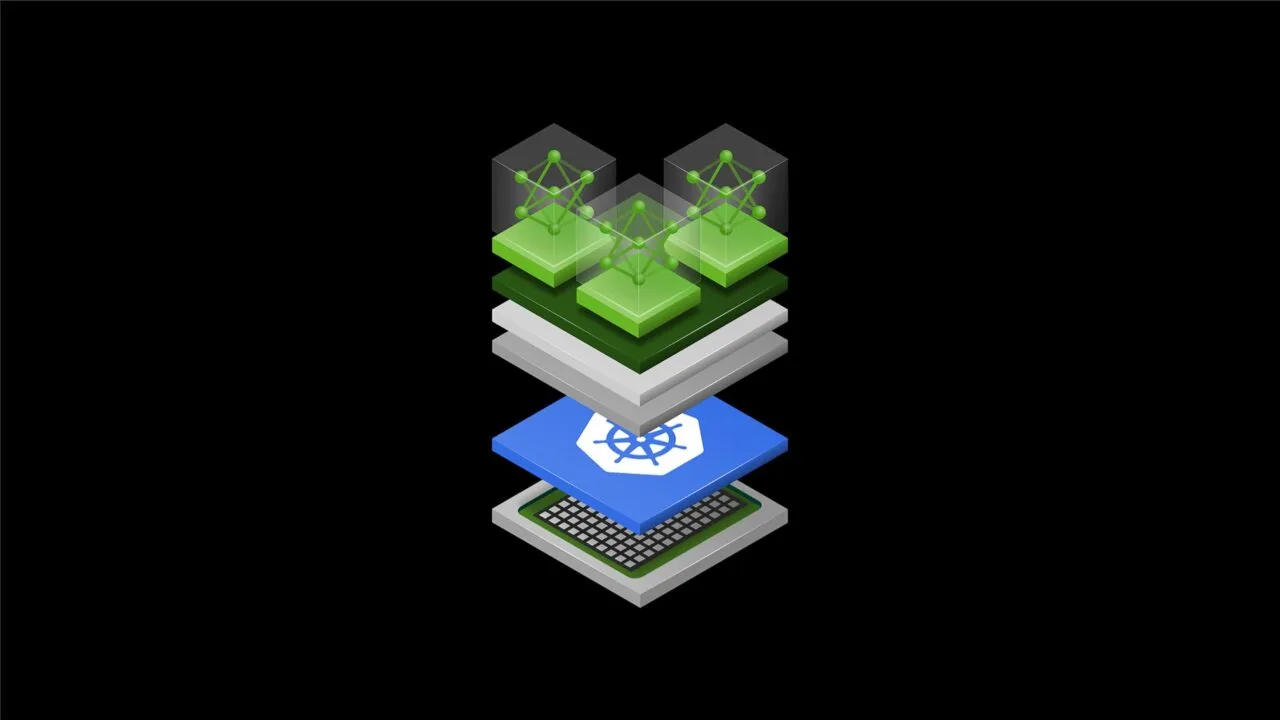

A infraestrutura por trás da inteligência artificial acaba de passar por uma mudança de paradigma. Durante a KubeCon Europe 2026, realizada em Amsterdã, a NVIDIA anunciou a doação de uma de suas tecnologias mais críticas para a Cloud Native Computing Foundation (CNCF): o driver de Alocação Dinâmica de Recursos (DRA) para GPUs.

O movimento marca uma transição importante. O que antes era um software sob governança exclusiva da fabricante, agora passa a ser propriedade da comunidade sob o projeto Kubernetes. Para o setor de tecnologia, isso sinaliza que até mesmo os gigantes do hardware reconhecem que o futuro da IA depende de padrões abertos e colaborativos.

O que é o Driver DRA e por que ele importa?

Historicamente, gerenciar o poder de processamento das GPUs em grandes data centers era uma tarefa complexa e, muitas vezes, limitada por barreiras de software proprietário. O driver NVIDIA Dynamic Resource Allocation (DRA) resolve esse gargalo ao permitir que o Kubernetes orquestre o hardware de forma muito mais granular.

Com essa tecnologia, desenvolvedores podem:

- Compartilhar recursos de forma inteligente: Através das tecnologias Multi-Process Service (MPS) e Multi-Instance GPU (MIG), uma única placa de vídeo de alta performance pode ser fatiada para atender a múltiplas tarefas simultâneas, otimizando o investimento em hardware.

- Reconfiguração em tempo real: A alocação de potência de processamento e memória pode ser alterada dinamicamente, sem a necessidade de reiniciar containers ou interromper fluxos de trabalho críticos.

- Precisão técnica: O sistema permite solicitações refinadas, onde o usuário define exatamente quanta memória ou qual arranjo de interconexão é necessário para uma aplicação específica de aprendizado de máquina.

Foco em Segurança: A chegada da Computação Confidencial

Um dos pontos mais sensíveis para empresas que lidam com dados bancários ou prontuários médicos é a segurança na nuvem. Até então, o isolamento de cargas de trabalho em GPUs era um desafio técnico.

Junto à doação do driver, a NVIDIA introduziu o suporte para Kata Containers. Isso significa que agora é possível rodar processos de IA dentro de máquinas virtuais leves que funcionam como contêineres, mas com isolamento de hardware robusto. Essa camada extra de proteção garante que os dados processados pela GPU fiquem inacessíveis para outros processos do servidor, elevando o padrão de computação confidencial.

Escalabilidade para a arquitetura Blackwell

A doação não foca apenas no presente, mas prepara o terreno para a próxima geração de supercomputadores. O driver DRA já integra suporte nativo para o NVIDIA Multi-Node NVLink, tecnologia essencial para os novos sistemas Grace Blackwell.

Em termos práticos, isso permite que centenas ou milhares de GPUs em diferentes nós de um data center “conversem” entre si com latência mínima, funcionando como um único superprocessador. Para o treinamento de modelos de linguagem de grande escala (LLMs), essa integração nativa com o Kubernetes é o que permitirá que a próxima onda de IAs seja treinada de forma mais rápida e com menor desperdício de energia.

Além dos drivers: O ecossistema KAI e OpenShell

A estratégia de abertura da NVIDIA em 2026 parece ser ampla. Além do driver DRA, o agendador de cargas de trabalho KAI Scheduler foi integrado como um projeto Sandbox da CNCF.

Outros projetos de código aberto foram destacados, como o NVIDIA OpenShell, voltado para a execução segura de agentes autônomos, e o Grove, uma API que simplifica a orquestração de sistemas de inferência complexos. Ao abrir essas ferramentas, a empresa tenta padronizar a forma como a IA é executada, independentemente de qual provedor de nuvem (AWS, Google Cloud ou Azure) o desenvolvedor esteja utilizando.

Análise: Por que a mudança agora?

Embora possa parecer um gesto de pura filantropia tecnológica, a abertura desses drivers é uma manobra estratégica. O mercado de IA está sob intensa pressão para se tornar mais transparente e menos dependente de “ecossistemas fechados”.

Ao entregar essas ferramentas para a comunidade, a NVIDIA neutraliza críticas sobre monopólio de software e garante que sua arquitetura continue sendo o padrão da indústria, agora validada e aprimorada por milhares de desenvolvedores independentes. Para o usuário final e para as empresas, o resultado é uma infraestrutura de IA mais estável, segura e, acima de tudo, eficiente.

Com informações de: NVIDIA Developer Blog